Le criticità della direttiva sul copyright. Analisi dell’articolo più controverso

28 min letturaAggiornamento 15 aprile: la direttiva è stata approvata dal Consiglio dell'Unione europea.

------------------------------

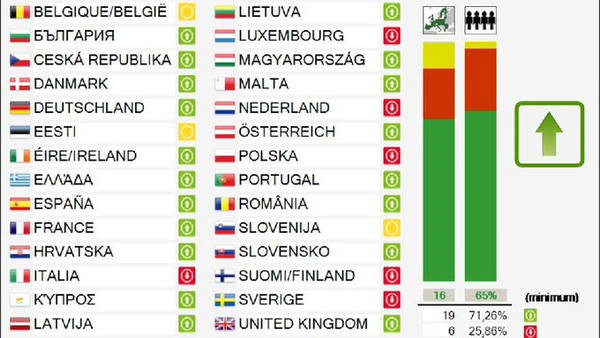

La Direttiva Copyright è stata approvata dal Parlamento europeo in sessione plenaria. Adesso dovrà passare al Consiglio dell'Unione europea (dal 15 aprile) e poi dovrà essere attuata dai singoli Stati.

La normativa appare estremamente complessa, in alcuni punti contraddittoria, e alcune norme sono redatte in maniera generica al punto che dovranno essere chiarite in sede attuativa. C’è il rischio che in prima battuta l’interpretazione delle norme sarà operata direttamente dalle grandi aziende che si troveranno a dover contrattare tra loro le licenze e gli ulteriori obblighi previsti dalla normativa. Solo in seconda battuta l’interpretazione sarà data da autorità statali ed infine dai tribunali nazionali.

In questa ottica è possibile che il recepimento in norme nazionali possa risolvere alcuni dubbi interpretativi, ma non è detto. C’è, invece, il forte rischio che ogni paese ne realizzi una versione diversa, così determinando una frammentazione ulteriore della normativa in materia. Potremmo avere fino a 27 norme differenti, e cioè comporterà altri problemi alle aziende che dovranno applicarle, perché dovranno assumere legali esperti in tutte le norme nazionali. Maggiori costi, quindi.

A confondere ulteriormente le cose, il testo finale della direttiva ha trovato una diversa numerazione, così l’articolo 13 è diventato l’articolo 17, ma il testo è rimasto sostanzialmente lo stesso. Nel seguito analizzeremo questo articolo.

[Nel post si utilizzerà la traduzione italiana per semplificare la comprensione, ma è stato tenuto in considerazione il testo inglese visto che al momento non esistono traduzioni ufficiali]

Prestatori di servizi di condivisione

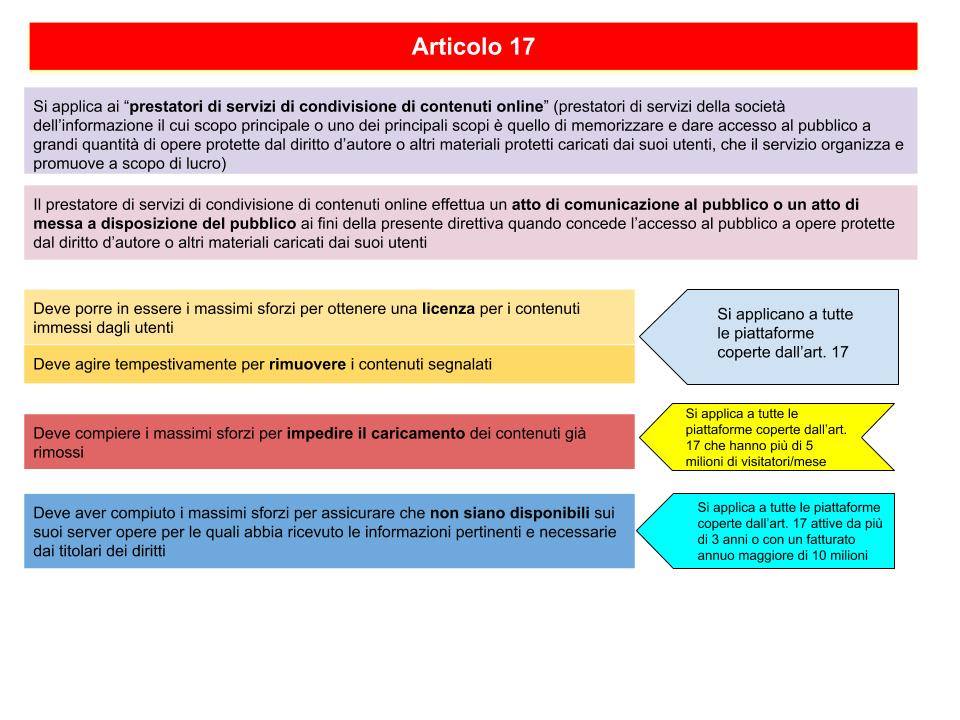

L’articolo 17 titola: “Utilizzo di contenuti protetti da parte di prestatori di servizi di condivisione di contenuti”. Infatti si rivolge ai “prestatori di servizi di condivisione di contenuti online” (online content sharing service providers, o OCSSP). Le definizioni si trovano nell’articolo 2, dove il “prestatore di servizi di condivisione di contenuti online” è “un prestatore di servizi della società dell’informazione il cui scopo principale o uno dei principali scopi è quello di memorizzare e dare accesso al pubblico a grandi quantità di opere protette dal diritto d’autore o altri materiali protetti caricati dai suoi utenti, che il servizio organizza e promuove a scopo di lucro”.

La definizione di “servizio della società dell’informazione” è ripresa dalla direttiva 2015/1535 (richiamata dall’articolo 2 della direttiva copyright): “qualsiasi servizio della società dell'informazione, vale a dire qualsiasi servizio prestato normalmente dietro retribuzione, a distanza, per via elettronica e a richiesta individuale di un destinatario di servizi”. “A distanza” si intende un servizio fornito senza la presenza simultanea di parti.

Il Considerando 62 della direttiva copyright chiarisce ulteriormente la definizione spiegando che comprende “unicamente i servizi che svolgono un ruolo importante sul mercato dei contenuti online, in concorrenza con altri servizi di contenuti online, come i servizi di streaming audio e video online, per gli stessi destinatari”. Quindi la direttiva “riguarda i servizi che hanno come scopo principale o come uno degli scopi principali quello di memorizzare e consentire agli utenti di caricare e condividere un gran numero di contenuti, al fine di trarne profitto, direttamente o indirettamente, organizzandoli e promuovendoli per attirare un pubblico più vasto, anche classificandoli e ricorrendo a promozione mirate al suo interno. Tali servizi non dovrebbero comprendere i servizi che hanno uno scopo principale diverso da quello di consentire agli utenti di caricare e condividere una grande quantità di contenuti protetti dal diritto d’autore allo scopo di trarre profitto da questa attività. Si tratta, ad esempio, dei servizi di comunicazione elettronica ai sensi della direttiva (UE) 2018/1972 del Parlamento europeo e del Consiglio, nonché dei prestatori di servizi cloud da impresa a impresa e di servizi cloud, che consentono agli utenti di caricare contenuti per uso personale, come i cyberlocker, o di mercati online la cui attività principale è la vendita al dettaglio online, e che non danno accesso a contenuti protetti dal diritto d’autore”.

È da notare la particolare tecnica di redazione della norma, in contrasto con la direttiva del 2015, che configura una classificazione estremamente particolareggiata, quasi da far intendere che la norma è stata scritta avendo in mente dei destinatari specifici. Purtroppo le leggi non funzionano (o non dovrebbero funzionare) così, perché, come ci si è accorti nel corso del dibattito, in una categoria, pur se particolareggiata, rientrano numerose altre realtà, anche non ancora nate. In tal modo appare evidente che la norma, più che guardare al futuro e quindi regolamentare anche modelli di business che potranno nascere un domani, guarda al passato, a ciò che già esiste, col rischio di limitare forme di business future. La conseguenza è stata che procedendo nel dialogo si è dovuto progressivamente introdurre una serie di esenzioni sempre più particolareggiate per tentare (in alcuni casi senza riuscirci) di escludere alcune realtà. E questo potrebbe portare a pensare che alcune specifiche realtà già esistenti semplicemente non sono state nemmeno prese in considerazione al momento della redazione della norma.

L’articolo 2, quindi, esclude espressamente alcune categorie di servizi: “I prestatori di servizi quali le enciclopedie online senza scopo di lucro, i repertori didattici o scientifici senza scopo di lucro, le piattaforme di sviluppo e di condivisione di software open source, i fornitori di servizi di comunicazione elettronica ai sensi della direttiva (UE) 2018/1972, i mercati online, i servizi cloud da impresa a impresa e i servizi cloud che consentono agli utenti di caricare contenuti per uso personali non sono prestatori di servizi di condivisione di contenuti online ai sensi della presente direttiva”.

Occorre dire che il concetto di “lucro” sul web è piuttosto particolare, perché la caratteristica del web è data proprio dall’interconnessione dei servizi e la possibilità di condividere contenuti (tramite i classici like o share) tra diverse piattaforme. Per questo motivo molti servizi online prevedono comunque licenze commerciali per i loro servizi anche se loro stesse non hanno alcuno scopo di lucro. Ad esempio, Wikipedia, pur essendo gratuita, consente il riutilizzo anche commerciale dei propri contenuti (per non parlare del fatto che si regge su donazioni), e cioè determina il rischio che l’esenzione, a seconda delle normative statali, potrebbe non applicarsi a Wikipedia. In ogni caso l’esenzione non pare applicarsi ad altri progetti collaborativi che fanno parte dello stesso ecosistema di Wikipedia, ma che non possono essere considerati enciclopedie (Wikiquote, Wikisource, Wikidata, Commons).

I gestori di telefonia e gli internet access provider sono esentati in quanto la loro attività principale non consiste nel condividere contenuti, ma nell’instradare la trasmissione. Un problema si ha con i cloud provider, visto che in alcuni casi sono utilizzati dagli utenti per condividere (tramite link diretto) i contenuti immessi nel cloud e talvolta si tratta anche di contenuti piratati. In questo caso, non dovrebbero comunque essere soggetti alla norma, sempre perché la loro attività principale non è la condivisione dei contenuti ma la fornitura di spazio per ospitarla. È però probabile che sul punto ci saranno aspre battaglie legali.

Nel testo, infine, non vi è alcuna indicazione per stabilire quando si è in presenza di una grande quantità di opere. Ma il Considerando 63 prevede che tale accertamento “dovrebbe essere effettuato caso per caso e dovrebbe tener conto di una combinazione di elementi, come l'utenza del servizio e il numero di file di contenuti protetti dal diritto d’autore caricati dagli utilizzatori del servizio”. Questo in realtà non aiuta molto nello stabilire se si è in presenza di una “grande quantità di opere”, e quindi alimenta l’incertezza relativamente all’applicazione della direttiva.

Comunicazione al pubblico

L’articolo 17 prevede che gli Stati membri debbano disporre che “il prestatore di servizi di condivisione di contenuti online effettua un atto di comunicazione al pubblico o un atto di messa a disposizione del pubblico ai fini della presente direttiva quando concede l’accesso al pubblico a opere protette dal diritto d’autore o altri materiali caricati dai suoi utenti”.

Questo è il punto focale dell’intero articolo. Di fatto va a modificare l’attuale normativa comunitaria.

Attualmente la direttiva Ecommerce prevede un’esenzione da responsabilità per i provider di hosting (che più o meno sono una categoria nella quale è inscritta la categoria dei “prestatori di servizi di condivisione di contenuti online” della direttiva copyright). In generale i provider, con riferimento ai contenuti immessi dai loro utenti, non sono responsabili delle informazioni trattate a patto che non intervengano sul contenuto o sullo svolgimento delle operazioni sui contenuti. E questo è quanto già è previsto in genere dagli ordinamenti nazionali. La normativa europea, inoltre, vieta anche un monitoraggio generalizzato dei contenuti immessi dagli utenti.

Il problema è dato dal fatto che un provider deve necessariamente svolgere alcune operazioni sulle informazioni trattate, altrimenti non potrebbe operare su di esse ed instradarle o ospitarle. Per cui spetta, in ultima battuta, al giudice nazionale stabilire se l’operazione posta in essere è una mera operazione tecnica (quindi consentita) oppure vi è l’intenzione di influire sulle informazioni, nel qual caso scatta la responsabilità del provider (in solido con l’utente, autore dell’illecito), in quanto il provider mostra di voler fare proprio il contenuto.

Per i fornitori di hosting i requisiti per poter usufruire dell’esenzione da responsabilità sono dettati dall’art. 16 del decreto di recepimento della direttiva Ecommerce (70 del 2003). E cioè, il provider diventa responsabile nel momento in cui ha l’effettiva conoscenza (actual knowledge) dell’illecito (da valutarsi in conformità dei principi dell’imputabilità penale) oppure se si trova in colpa per negligenza a fronte dell’allegazione della conoscenza sostanziale di fatti o circostanze che rendano manifesta l’illiceità dell’attività o del contenuto.

Su questi elementi si è avuta una evoluzione giurisprudenziale che ha fissato l’interpretazione degli stessi, al fine di una corretta valutazione della responsabilità del provider. A fronte dell'evoluzione della magistratura nazionale l'evoluzione della giurisprudenza della Corte di Giustizia europea ha progressivamente esteso l’ambito della responsabilità del provider, passando da una “actual knowlege” ad una “constructive knowledge”, cioè dalla consapevolezza effettiva a quella solo presunta, ritenendo che l’operatore economico debba agire in base ad uno specifico criterio di diligenza. È da notare che si tratta di un’estensione che non corrisponde al testo letterale della direttiva Ecommerce.

Ad esempio, nel caso GS-Media, la Corte europea arriva a riconoscere la responsabilità del provider in base alla mera presunzione derivante dall’esistenza di un fine di profitto. Se ci guadagna deve fare più attenzione e la sfera di responsabilità è più ampia. Ovviamente si tratta solo di una presunzione e come tale può essere confutata. Ma è indubbio il salto in avanti.

In tal senso, il “ruolo” del provider è divenuto un altro elemento rilevante che ha prodotto numerose pronunce, nazionali e non, su quando il provider debba considerarsi “attivo”. Nel qual caso, avendo una specifica intenzione di manipolazione dei contenuti, ne sarebbe corresponsabile.

Mentre la giurisprudenza italiana in genere ha valutato l’indicizzazione e i suggerimenti di ricerca un mero espediente tecnologico volto al miglioramento dello sfruttamento economico della piattaforma, con la sentenza L’Oreal vs Ebay, la Corte europea afferma che ruolo attivo è anche l’ottimizzazione della presentazione dei contenuti o la loro promozione.

Se fino ad oggi il provider ha una responsabilità secondaria, come da condotte di favoreggiamento o facilitative ad un comportamento altrui, con la direttiva il provider ne risponde in prima persona come se la condotta fosse stata posta in essere da esso stesso. A tal proposito, non dobbiamo dimenticare che stiamo parlando dell’immissione del contenuto sui server che in realtà è operazione compiuta dall’utente, e che è tecnicamente un atto di comunicazione al pubblico. Quindi la direttiva addossa anche al provider la responsabilità di un atto di comunicazione al pubblico tecnicamente posto in essere dall’utente. E, per un atto di comunicazione al pubblico occorre l’autorizzazione del titolare dei diritti.

Piattaforme come Youtube (a differenza dei servizi di streaming come Spotify) non sono attualmente obbligate a ottenere una licenza dai titolari dei diritti per i contenuti immessi dagli utenti, proprio perché solo l’utente, fino ad oggi, è stato considerato colui che pone in essere la comunicazione al pubblico. Il provider può eventualmente, rispondere in concorso con l’utente in presenza di determinati presupposti, in genere se non rimuove speditamente il contenuto in caso di segnalazione dello stesso, ma non per un atto di comunicazione al pubblico.

Inoltre, la stessa Corte europea ha più volte sottolineato che per stabilire se si è in presenza di una comunicazione al pubblico sono richiesti requisiti che vanno applicati individualmente, e che sono interdipendenti. In sostanza, occorre una valutazione caso per caso delle circostanze (che apre a forti incertezze giuridiche), valutazione che mal si concilia con dei filtri preventivi generalizzati.

Ad esempio, nella sentenza GS Media la Corte UE ritiene che si possa presumere la “conoscenza” dell’illecito in quanto il provider opera per profitto. Poi nella successiva sentenza Pirate Bay il profitto diventa solo uno tra altri elementi, a significare che, probabilmente, la “consapevolezza” necessaria per far scattare la responsabilità debba essere, appunto, calibrata caso per caso. Però, con la sentenza Pirate Bay la Corte europea sostiene che la gestione di una piattaforma online può costituire atto di comunicazione al pubblico, in quanto facilita la fruibilità di contenuti da parte degli utenti. In tal modo, la Corte estende il concetto di “comunicazione al pubblico” ricomprendendo in esso anche condotte meramente facilitative dell’accesso alle opere online, che originariamente costituivano responsabilità secondaria la cui regolamentazione è demandata alle legislazioni nazionali (non armonizzate). Per cui si considera comunicazione al pubblico, e quindi occorre l’autorizzazione del titolare, non solo se la piattaforma diffonde l’opera, ma anche se si limita a rendere più semplice l’accesso alla stessa, ad esempio tramite un link (i torrent e i magnet, usati da Pirate Bay, sono dei link fondamentalmente) o forme di ottimizzazione della presentazione dei contenuti. In tal modo la responsabilità secondaria viene progressivamente inglobata in quella primaria, realizzando un’armonizzazione della materia a livello europeo.

A tal proposito è utile notare che una piattaforma come Youtube differisce da PirateBay proprio perché , pur avendo un motore di ricerca interno e un sistema di categorizzazione dei contenuti, YouTube vieta espressamente ai suoi utenti il caricamento di video che violano il copyright, mentre Pirate Bay li incoraggia, e YouTube adotta specifiche misure tecniche per la rimozione dei contenuti in violazione. In tal senso, si può sostenere che YouTube non ha una conoscenza tale dei contenuti, non svolge un ruolo così indispensabile alla loro diffusione, da diventarne responsabile.

Tutto questo viene portato agli estremi nella direttiva copyright, laddove l’art. 17 dispone che “il prestatore di servizi di condivisione di contenuti online effettua un atto di comunicazione al pubblico o un atto di messa a disposizione del pubblico ai fini della presente direttiva quando concede l’accesso al pubblico a opere protette dal diritto d’autore o altri materiali caricati dai suoi utenti”. Con la direttiva non c’è alcuna necessità di accertare l’esistenza di una consapevolezza oppure di elementi ulteriori, di fatto il provider (o meglio la categoria ristretta di provider individuata dalla norma) effettua sempre un atto di comunicazione al pubblico con riferimento ai contenuti immessi dagli utenti. Il che di per sé è già paradossale perché il provider non ha conoscenza del contenuto, quindi non può esprimere alcuna intenzione di farlo proprio, se non dopo che il contenuto è stato già immesso nei server. Fermo restando la difficoltà (o vera e propria impossibilità) per un provider (come Youtube) di avere conoscenza di tutti i contenuti effettivamente immessi sui suoi server, data l’enorme quantità.

Il Considerando 64 precisa che “ciò non pregiudica il concetto di comunicazione al pubblico o di messa a disposizione al pubblico in altri ambiti del diritto dell’Unione, né l’eventuale applicazione dell’articolo 3, paragrafi 1 e 2, della direttiva 2001/29/CE ad altri prestatori di servizi che utilizzano contenuti protetti dal diritto d’autore”. Questo crea ancora maggiore confusione legale, poiché avremo due concetti di “comunicazione al pubblico” nell’ambito del diritto dell’Unione a seconda dei casi. In ogni caso è palese che la norma influenzerà certamente la Corte europea nell’interpretazione del concetto di “comunicazione al pubblico”.

Autorizzazioni e licenze

Poiché il provider pone in essere sempre una comunicazione al pubblico, “deve pertanto ottenere un’autorizzazione dai titolari dei diritti di cui all’articolo 3, paragrafi 1 e 2, della direttiva 2001/29/CE, ad esempio mediante la conclusione di un accordo di licenza”.

Ma se un provider “deve” ottenere una licenza perché un utente possa immettere quel contenuto sui suoi server, dovrebbe innanzitutto sapere che tipo di contenuto è. Poiché, ovviamente, non lo può sapere prima che il contenuto sia immesso sui server, le possibilità sono solo due: o lascia il contenuto in sospeso, lo analizza, poi procede ad acquisire la licenza e infine lo pubblica solo dopo aver acquisito la licenza, oppure acquisisce tutte le licenze per tutti i contenuti possibili ed immaginabili, quindi anche, presumibilmente, per contenuti che non saranno mai immessi sui suoi server. Da qui si capisce che fondamentalmente la direttiva alimenta un enorme mercato delle licenze, favorendo i produttori di contenuti. Non solo, questo inevitabilmente determinerà un costo eccessivo per molte piattaforme.

Sopraggiunge un’ulteriore complicazione. Se probabilmente le Majors musicali avranno tutto l’interesse a cedere le licenze (del resto già lo fanno), nel settore audiovisual (film, tv) le cose non vanno allo stesso modo, in quanto le aziende cinematografiche non sempre cedono le licenze e non le cedono mai a tutti, anzi tendono a restringere il più possibile la circolazione delle stesse, essendo tali restrizioni alla base del loro modello di business. Per cui c’è il rischio che un provider voglia acquisire una licenza ma non possa acquistarla perché non è in vendita. Oppure perché, approfittando del fatto che il provider “deve” acquisirla per forza, la licenza viene aumentata enormemente di prezzo.

Per tale motivo si prevede che il provider non sia responsabile per atti non autorizzati se dimostra di “a) aver compiuto i massimi sforzi per ottenere un’autorizzazione”. È palese che non essendoci alcuna indicazione su cosa si possa intendere per “massimi sforzi” (best effort) questo crea una forte incertezza e difficoltà applicative. Un provider si troverà costantemente in una situazione di non sapere se viola o meno la legge, e di poter essere portato in qualsiasi momento dinanzi ad un giudice. Quale imprenditore inizierebbe un’attività avendo la consapevolezza che nessuno gli può assicurare che è conforme alle leggi?

In realtà il paragrafo 4 precisa che non è sufficiente solo “aver compiuto i massimi sforzi per ottenere un’autorizzazione”, ma occorrono altri due requisiti perché il provider vada esente da responsabilità. E cioè:

b) “aver compiuto, secondo elevati standard di diligenza professionale di settore, i massimi sforzi per assicurare che non siano disponibili opere e altri materiali specifici per i quali abbiano ricevuto le informazioni pertinenti e necessarie dai titolari dei diritti”

c) “aver agito tempestivamente, dopo aver ricevuto una segnalazione sufficientemente motivata dai titolari dei diritti, per disabilitare l’accesso o rimuovere dai loro siti web le opere o altri materiali oggetto di segnalazione e aver compiuto i massimi sforzi per impedire il caricamento in futuro conformemente alla lettera b)”.

Devono occorrere tutte e tre le condizioni perché il provider possa andare esente da responsabilità per contenuti non autorizzati immessi dagli utenti sui loro server, nel caso in cui non sia riuscito ad ottenerne le licenze.

Il paragrafo 2 stabilisce che quando un provider (sempre come sopra definito) ottiene un’autorizzazione, “tale autorizzazione includa anche gli atti compiuti dagli utenti dei servizi che rientrano nell’ambito di applicazione dell’articolo 3 della direttiva 2001/29/CE”. Il ché potrebbe far pensare che una volta ottenuta la licenza per un contenuto, l’utente potrebbe immetterlo tranquillamente sui server della piattaforma. Ma purtroppo non è così, perché l’articolo continua “qualora non agiscano su base commerciale o qualora la loro attività non generi ricavi significativi”. E qui torniamo alle solite difficoltà interpretative, su cosa si debba ritenere attività commerciale e “ricavi significativi”. Si tratta di problematiche che dovrebbero essere risolte dalle legislazioni nazionali, per le quali in genere (come in Italia) anche un ricavo da banner pubblicitari di pochi euro è considerata attività commerciale.

Quindi, in caso in cui l’utente agisca su base commerciale, dovrà acquisire anche lui una separata licenza, per cui lo stesso atto di comunicazione al pubblico verrà pagato due volte al titolare dei diritti.

Il paragrafo 3, infine, prevede che “quando il prestatore di servizi di condivisione di contenuti online effettui un atto di comunicazione al pubblico o un atto di messa a disposizione del pubblico alle condizioni stabilite dalla presente direttiva, la limitazione di responsabilità di cui all’articolo 14, paragrafo 1, della direttiva 2000/31/CE non si applica alle fattispecie contemplate dal presente articolo”.

Cioè, se il provider è responsabile in via primaria per il contenuto immesso dall’utente sul server, ovviamente non potrà usufruire dell’esenzione stabilita per i provider di hosting dalla direttiva Ecommerce. Il ché ci riporta al fatto che la direttiva copyright di fatto modifica l’attuale normativa comunitaria. Ma la norma continua precisando che “il primo comma del presente paragrafo non pregiudica la possibile applicazione dell’articolo 14, paragrafo 1, della direttiva 2000/31/CE a tali prestatori di servizi per finalità che non rientrano nell'ambito di applicazione della presente direttiva”, con ciò alimentando confusione ed incertezza.

In tal modo si conferma l’idea che con la direttiva copyright l’Europa abbandona l’approccio generalizzato per abbracciare l’approccio settoriale di stampo americano, con la finalità di intervenire in singoli settori con norme specifiche e la moltiplicazione delle eccezioni, con evidenti ricadute negative sulla certezza del diritto.

Tecnologie di filtraggio

Il punto b) sopra citato è quello che ha dato adito a più discussioni, essendo quello che riguarda le tecnologie di filtraggio dei contenuti. Se il testo della norma un tempo prevedeva espressamente l’uso di tecnologie di filtraggio (content recognition technologies), le critiche hanno determinato l’eliminazione del riferimento, per cui adesso la norma prevede genericamente che il provider debba assicurare che non siano disponibili sui suoi server opere in violazione dei diritti dei titolari. Su tale obbligo si sono concentrate vere e proprie battaglie verbali, laddove anche la Commissione europea, i politici, e parte dell’industria del copyright, hanno asserito che la direttiva non prevederebbe più l’uso di tecnologie di filtraggio dei contenuti. In effetti ciò è vero, nel senso che la norma non lo prevede espressamente. Quello che la norma prescrive è solo che il provider debba assicurare che determinati contenuti non siano presenti sui loro server, come ciò debba accadere è un problema del provider. È un obbligo di risultato, non un obbligo di mezzi. Purtroppo allo stato dell’attuale tecnologia è evidente che l’unico modo effettivo di assicurare tale obbligo di risultato è tramite le tecnologie di filtraggio, cioè controllando tutti i contenuti immessi sui server per verificare se un contenuto è illecito.

La normativa europea, infatti, vieta il monitoraggio generale (come è stato sancito anche da due sentenze della CGUE), lo ammette solo in casi specifici (Considerando 47 e 48 della direttiva Ecommerce). Il considerando 48, in particolare, consente agli Stati di prevede “doveri di diligenza” al fine di individuare e prevenire determinati tipi di attività illegali. E questo è previsto anche nella direttiva IPRED (2004/48/CE, sul rispetto dei diritti di proprietà intellettuale), che impone agli Stati membri di garantire che i tribunali possano emettere ingiunzioni nei confronti di intermediari per prevenire le infrazioni. Con la proposta di riforma della direttiva copyright, quindi, si tende a valorizzare il Considerando 48, ignorando che l’articolo 15 della direttiva Ecommerce è chiara nello stabilire un divieto di controlli generalizzati, come quelli che si vorrebbero prevedere. Quindi nella direttiva non è possibile imporre un monitoraggio generalizzato, perché la norma si esporrebbe al giudizio della Corte europea. Infatti il Considerando 66 precisa che “gli obblighi di cui alla presente direttiva non dovrebbero indurre gli Stati membri a imporre un obbligo generale di sorveglianza”, e ciò viene ribadito nel paragrafo 8: “l’applicazione del presente articolo non comporta alcun obbligo di sorveglianza”.

Il problema viene aggirato semplicemente ponendo i provider nella condizione di non poter fare altrimenti che utilizzarli, senza però dirlo espressamente.

Occorre però aggiungere che è stata data una lettura della norma che giustifica, in un certo senso, l’idea che la direttiva non preveda obblighi generalizzati di filtraggio. Questo perché l’obbligo di monitoraggio sarebbe sussistente solo nei soli casi in cui la piattaforma ha ottenuto dai titolari le informazioni per attivare i filtri. I provider, infatti, dovranno compiere i “massimi sforzi” per impedire il caricamento di opere e materiali “per i quali abbiano ricevuto le informazioni pertinenti e necessarie dai titolari dei diritti”. Ma anche qui appare evidente che si tratta di un modo per aggirare un divieto normativo.

Le “informazioni” si riferiscono, ovviamente, a quei dati che i titolari dovranno inviare ai provider al fine di “riconoscere” le opere per le quali impedire la disponibilità. E, a seconda dei tipo di tecnologia di filtraggio utilizzata, possono essere semplici metadata, hash, oppure fingerprint. L’unico metodo davvero efficace per identificare un file e verificare se si tratti di una copia, casomai illecita, di altro file, sembrerebbe il fingerprint. Anche se è doveroso però precisare che il fingerprint, pur essendo il metodo più efficace (e veloce), non è necessariamente affidabile, perché proprio per le sue caratteristiche è passibile di errori, intesi sia come falsi positivi (overblocking) che negativi.

Potrebbe accadere che il titolare dei diritti semplicemente non voglia dialogare con una specifica piattaforma, e quindi non voglia fornire dati relativi alle opere nel suo catalogo. In quel caso la piattaforma si troverebbe nell’impossibilità di riconoscere le opere e quindi impedirne il caricamento, in assenza dell’elemento con cui comparare il contenuto immesso dagli utenti. In questo caso non sarebbero soggette ad obbligo di filtraggio generalizzato.

Varie aziende si sono lamentate in passato del fatto che l’industria del copyright non fornisce loro informazioni utili a riconoscere i contenuti, come ad esempio 4shared che, pur implementando un sistema di filtraggio analogo a quello di Google, ha sostenuto che i titolari dei diritti preferiscono inviare richieste di takedown direttamente al motore di ricerca Google, piuttosto che fornire i dati a loro. Ecco perché la norma richiama le “informazioni pertinenti”.

La norma aggiunge anche: “secondo elevati standard di diligenza professionale di settore”. Su questo punto occorre dire che le grandi piattaforme del web già utilizzano (dato l’enorme numero di contenuti immessi sui loro server) tecnologie di riconoscimento dei contenuti. L’industria del copyright, però, potrebbe chiedere di più rispetto ai risultati ottenuti finora. In aggiunta si prevede che il provider debba assicurare i massimi sforzi (best effort), probabilmente proprio perché nel corso del dibattito è emerso chiaramente che le tecnologie di filtraggio non sono affatto infallibili, anzi, quanto più si “regola” l’algoritmo per massimizzare la rimozione delle opere segnalate, tanto più c’è il concreto rischio che l’algoritmo rimuova anche contenuti del tutto leciti. Senza dimenticare che allo stato risulta del tutto impossibile far distinguere ad un algoritmo un contenuto illecito da uno lecito perché costituente eccezione (parodia, satira, ecc…). Il Considerando 66, infatti, precisa che le “misure adottate” “non dovrebbero impedire la disponibilità di contenuti che non violano il diritto d’autore, comprese opere o altri materiali il cui utilizzo è oggetto di un accordo di licenza, o da un’eccezione o limitazione al diritto d’autore e ai diritti connessi”. Si tratta di obblighi generici per i quali non sono previste sanzioni, per cui i provider sono incentivati a rimuovere tutto ciò che è incerto, per non doverne rispondere direttamente nei confronti dei titolari dei diritti.

Il punto c), infine, prevede che il provider debba agire tempestivamente per rimuovere i contenuti oggetto di segnalazione. Sostanzialmente si tratta della trasposizione degli attuali obblighi, come previsto dalla direttiva Ecommerce. In materia si è già formata ampia giurisprudenza interpretativa. È da notare che la norma fa riferimento non a contenuti illeciti bensì “oggetto di segnalazione”. Ciò che rileva, quindi, non è l’illiceità ma la valutazione del titolare dei diritti. Fermo restando quanto detto sopra.

A tale obbligo, già esistente, si aggiunge l’obbligo di compiere i massimi sforzi per impedire il caricamento in futuro del contenuto segnalato. Si tratta del cosiddetto “notice and stay down” che prevede, appunto, che il provider debba non solo rimuovere il contenuto segnalato ma “tenerlo giù”, cioè adoperarsi perché quel contenuto non sia reimmesso nei server (e quindi a maggior ragione dovrà controllare tutti i contenuti immessi nei suoi server). L’approccio era già stato vagliato in precedenza, non solo dalla Commissione europea in sede di studio della riforma della direttiva copyright, ma dalla stessa Corte di Giustizia europea che nelle due sentenze Sabam aveva precisato che se il monitoraggio globale è in violazione delle norme comunitarie, non lo è il monitoraggio specifico ad un singolo contenuto, purché l’ordine sia limitato nel tempo. In questo caso, però, non si prevede limitazione temporale.

Il paragrafo 5 chiarisce che “per stabilire se il prestatore di servizi si è conformato agli obblighi di cui al paragrafo 4 e alla luce del principio di proporzionalità, sono presi in considerazione, tra gli altri, gli elementi seguenti:

a) la tipologia, il pubblico e la dimensione del servizio e la tipologia di opere o altri materiali caricati dagli utenti del servizio; e

b) la disponibilità di strumenti adeguati ed efficaci e il relativo costo per i prestatori di servizio”.

Il riferimento è alla “diligenza professionale”, i “massimi sforzi”, ecc…, che andranno tutti interpretati tenendo conto di quanto precisato in questo paragrafo. Il Considerando 66 precisa che per tale valutazione “occorre considerare se il prestatore di servizi abbia adottato tutte le misure che un operatore diligente adotterebbe per ottenere il risultato di impedire la disponibilità di opere o altri materiali non autorizzati sul suo sito web, tenendo conto delle migliori pratiche del settore e dell’efficacia delle misure adottate alla luce di tutti i fattori e sviluppi pertinenti, nonché del principio di proporzionalità”. L’aggiunta del “principio di proporzionalità” è importante perché porterà a tenere in conto anche la dimensione e le risorse della piattaforma, anche se, ovviamente, è palese che la genericità delle norme determinerà una fortissima incertezza giuridica. Sarà piuttosto difficile che un imprenditore si lanci nell’impresa di avviare una nuova piattaforma, almeno fino a quando la giurisprudenza sul punto non si sia consolidata. Occorreranno, per questo, parecchi anni.

Esenzioni per le imprese

Il paragrafo 6 stabilisce le esenzioni per le aziende. In particolare i provider “i cui servizi sono disponibili al pubblico nell’Unione da meno di tre anni e che hanno un fatturato annuo inferiore a 10 milioni di EUR calcolati in conformità della raccomandazione 2003/361/CE della Commissione” (si tratta della Raccomandazione che definisce le microimprese, le piccole e le medie imprese) devono sottostare solo alle condizioni di cui al paragrafo 4, lettera a) e alla “circostanza di aver agito tempestivamente, in seguito alla ricezione di una segnalazione sufficientemente motivata, per disabilitare l’accesso alle opere o ad altri materiali notificati o rimuovere dai loto siti web tali opere o altri materiali”.

Quindi, nel caso di provider con meno di 3 anni di attività e meno di 10 milioni di fatturato, devono cumulativamente:

– Aver compiuto i massimi sforzi per ottenere le licenze per i contenuti immessi dagli utenti, e

– Rispettare gli obblighi di rimuovere tempestivamente i contenuti segnalati (come da direttiva Ecommerce).

Ma, “se il numero medio di visitatori unici mensili di tali prestatori di servizi supera i 5 milioni, calcolati sulla base del precedente anno civile, essi devono dimostrare altresì di aver compiuto i massimi sforzi per impedire l’ulteriore caricamento di opere o di altri materiali oggetto della segnalazione per i quali titolari dei diritti abbiano fornito informazioni pertinenti e necessarie”.

In conclusione, le aziende con meno di 3 anni di attività e meno di 10 milioni di fatturato annuo (requisiti cumulativi non alternativi), devono attivarsi per ottenere le licenze, non devono filtrare preventivamente i contenuti, ma devono attivarsi su segnalazione per rimuovere i contenuti. Se però superano i 5 milioni di utenti devono in aggiunta anche attivarsi perché i contenuti rimossi non siano reimmessi sui server. Solo un numero limitato di piattaforme saranno escluse dall'obbligo di implementare i filtri di caricamento, e solo temporaneamente.

Diritti degli utenti

Il paragrafo 7 stabilisce che la cooperazione tra provider e titolari dei diritti “deve impedire la disponibilità di opere o di altri materiali caricati dagli utenti, che non violano il diritto d’autore o i diritti connessi, anche nei casi in cui tali opere o altri materiali siano oggetto di un’eccezione o limitazione”. Inoltre, “gli Stati membri provvedono affinché gli utenti di ogni Stato membro possano avvalersi delle seguenti eccezioni o limitazioni esistenti quando caricano o mettono a disposizione contenuti generati dagli utenti tramite i servizi di condivisione di contenuti online: a) citazione, critica, rassegna; b) utilizzi a scopo di caricatura, parodia o pastiche”.

È positivo che si è concordata l’obbligatorietà di altre delle attuali eccezioni previste originariamente come facoltative dalla direttiva InfoSoc, almeno per quanto riguarda gli usi che rientrano nel campo di applicazione dell'articolo 17. Di contro non è previsto alcun modo per rendere tali eccezioni realmente applicabili, visto che i sistemi di filtraggio notoriamente sono incapaci di riconoscere le eccezioni. Ad esempio, uno studio del 2018 (“This Video is Unavailable”: Analyzing Copyright Takedown of User-Generated Content on YouTube) rivela che, con riferimento a video parodistici caricati dagli utenti, circa il 33% sono stati rimossi per motivi di copyright. La direttiva si limita a stabilire, anche qui, un obbligo di risultato, senza aggiungere null’altro. Se il problema è che i provider dovranno impedire il caricamento di opere in violazione dei diritti dei titolari a pena di doverne rispondere direttamente, e nel contempo non esiste alcuna sanzione nel caso in cui siano, invece, violati i diritti dei cittadini, appare evidente che vi è un forte incentivo a rimuovere tutto ciò che è in dubbio, con gravi ricadute sulle libertà fondamentali dei cittadini.

Infatti, se il provider non rimuove un contenuto illecito ne risponderà, ma se invece per eccesso di zelo rimuove un contenuto del tutto lecito, oppure ricompreso tra le eccezioni al copyright, il massimo che potrà accadere è che il cittadino attivi il meccanismo di reclamo previsto dal paragrafo 9: “Un meccanismo di reclamo e ricorso celere ed efficace che sia disponibile agli utenti dei loro servizi in caso di controversie in merito alla disabilitazione dell’accesso a, o alla rimozione di, specifiche opere o altri materiali da essi caricati”.

Qualcosa del genere è già attuato in maniera volontaria dalle grandi piattaforme del web che hanno predisposto meccanismi di notice and takedown, consentendo agli utenti di far valere le proprie ragioni nel momento in cui ritengano che la rimozione del loro contenuto sia stata effettuata senza alcun motivo. Occorre dire che tali meccanismi, basati per lo più sulla normativa americana, non appaiono in grado di tutelare realmente gli utenti e i loro diritti, per la farraginosità del sistema, perché alla fine è sempre il titolare dei diritti a decidere. In linea di massima, il provider si limita a girare al titolare dei diritti il reclamo, il quale titolare, essendo il soggetto che ha inviato la segnalazione, difficilmente potrà ammettere di essersi sbagliato. Per cui spesso il reclamo non ottiene alcun effetto, a meno che l’utente non abbia un certo seguito sulla piattaforma, tale da poter scatenare i suoi fan contro la piattaforma stessa e ottenere, quindi, il ripristino del contenuto.

Il meccanismo previsto dalla direttiva prevede che i reclami siano trattati “senza indebito ritardo e le decisioni volte a disabilitare l’accesso o a rimuovere i contenuti caricati sono soggette a verifica umana”. Questo implica un qualcosa di più rispetto a quanto talvolta assicurato dalla piattaforme, che spesso utilizzano sistemi automatizzati per la valutazione dei reclami, laddove l’intervento umano avviene solo in seconda battuta, eventualmente. In tal senso la direttiva potrebbe portare a maggiori costi per i provider e, dato la grande quantità di contenuti immessi sui loro server, è facile immaginare che i tempi della verifica “umana” saranno decisamente elevati.

Inoltre, tale obbligo, richiamato anche dal Considerando 70, di fatto sancisce che i sistemi automatizzati di filtraggio dei contenuti non sono sufficienti per valutare la liceità di un contenuto in quanto, ad esempio, incapaci di riconoscere una parodia.

In ultima battuta, comunque, la direttiva prevede la possibilità per l’utente di rivolgersi ad un’autorità statale oppure ad un tribunale per la disamina del caso. Si prevedono, infatti, “meccanismi di ricorso stragiudiziali”, fatto salvo il “diritto degli utenti di avvalersi di mezzi di ricorso giurisdizionali efficaci”. Si tratta degli out-of-court redress mechanism da realizzare al di fuori dei normali ricorsi giurisdizionali previsti dagli Stati. Gli Stati nazionali dovranno, quindi, predisporre tali sistemi di ricorso stragiudiziale, affidandoli a autorità indipendenti (es. Agcom), cosa che porterà a sostanziali investimenti da parte loro.

È evidente che in tal modo si scarica sull’utente il costo della tutela dei propri diritti, laddove, di contro, il costo della tutela dei diritti dell’industria del copyright è scaricato sulle piattaforme del web o, in seconda battuta, sugli Stati membri che dovranno predisporre i “meccanismi di ricorso stragiudiziali” (col rischio che il costo sia poi trasferito ai cittadini).

Infine, tali meccanismi non devono pregiudicare la possibilità per gli utenti di rivolgersi ai tribunali nazionali “per far valere l’applicazione di un’eccezione o di una limitazione al diritto d'autore e ai diritti connessi”.

Quindi, se da un lato i provider devono garantire che contenuti illeciti non siano caricati sui loro server, a pena di doverne rispondere in prima persona, nel caso in cui le rimozioni tocchino contenuti leciti in quanto coperti da eccezioni o limitazioni al diritto d’autore, gli utenti potranno in prima battuta rivolgersi allo stesso provider, in seguito avviare un ricorso stragiudiziale, infine ai tribunali nazionali. Si tratta di una serie di meccanismi, anche piuttosto onerosi, sia in termini di costo che di organizzazione, che di fatto hanno l’unico scopo di tutelare gli interessi dell’industria del copyright, la cui tutela viene direttamente scaricata sulle piattaforme, gli Stati nazionali e quindi i cittadini stessi.

Allo stato non esiste alcun reale deterrente per i titolari dei diritti nell’effettuare le segnalazioni, e ciò ha già portato a numerosi casi di abuso. Vi è un ovvio incentivo a rimuovere il più possibile, salvo poi andarne a discutere ex post (dopo la rimozione) in altre sedi, semmai il cittadino vorrà sobbarcarsi la spesa (non indifferente per un tribunale) per dimostrare che il suo contenuto era lecito, con inversione del principio di colpevolezza. Si spera che gli Stati membri, nel recepire la direttiva, finalmente avviino una discussione sul punto, prendendo in considerazione sanzioni nei casi in cui la segnalazione da parte del titolare abbia comportato la rimozione di un contenuto che poi si è accertato fosse del tutto lecito. La direttiva non lo prevede ma è possibile intervenire in tal senso a livello nazionale.

Per ultimo è da notare che gli Stati membri non possono invocare i diritti fondamentali dei cittadini, come la libertà di manifestazione del pensiero, per limitare ulteriormente il diritto d’autore, essendo il bilanciamento nella competenza esclusiva del legislatore e già operato dal legislatore dell’UE. Una estensione delle eccezioni, secondo la giurisprudenza europea, porterebbe ad annullare l’effetto di armonizzazione del copyright. Non dimentichiamo che la direttiva copyright è inscritta nel Digital Single Market, il quale è basato sui valori neoliberali, cioè è più probabile che favorisca le transazioni di mercato e l'imprenditorialità piuttosto che valori sociali.

Obblighi ulteriori per i provider

Il paragrafo 8, dopo aver precisato che l’applicazione dell’articolo non comporta alcun obbligo di sorveglianza, imponendo quindi un obbligo di risultato e non di mezzi, impone altresì che i provider debbano fornire ai titolari dei diritti “informazioni adeguate sul funzionamento delle loro prassi per quanto riguarda la cooperazione di cui al paragrafo 4 e, qualora siano stati conclusi accordi di licenza tra i prestatori di servizi e i titolari dei diritti, informazioni sull’utilizzo dei contenuti oggetto degli accordi”.

In sostanza, i provider dovranno dimostrare di aver ottemperato agli obblighi previsti dalla normativa, fornendo tale prova direttamente ai titolari dei diritti.

Risulta sempre più ovvio che la tutela degli interessi economici dell’industria del copyright viene posta in posizione predominante rispetto agli interessi economici delle piattaforme del web.

Tutela dei dati personali

L’art. 17, paragrafo 9, in uno al Considerando 70, prevede che la direttiva copyright “non comporta l’identificazione dei singoli utenti né il trattamento dei dati personali, salvo conformemente alla direttiva 2002/58/CE e al regolamento (UE) 2016/679”.

La direttiva 2002/58/CE è la direttiva Eprivacy, attualmente in fase di riforma, mentre il regolamento 2016/679 è il GDPR.

La questione è complessa. In teoria l’utilizzo di filtri di caricamento potrebbe avvenire anche senza raccogliere dati personali, ma siccome la direttiva prevede che le piattaforme debbano tenere conto anche delle eccezioni al copyright, e tali eccezioni sono legate all’uso del contenuto, in alcuni casi potrebbe essere impossibile non analizzare anche chi, e in quali circostanze (data, località...), sta caricando il contenuto per una corretta valutazione. Senza dimenticare che poi la piattaforma deve consentire all’utente di presentare un reclamo.

In sostanza, la piattaforma dovrebbe analizzare le comunicazioni tra utente e servizio. Sorge il dubbio su quale possa essere la base giuridica per il trattamento di tali dati, di sicuro non il consenso. Potrebbe rinvenirsi nell’obbligo legale, se non fosse che la direttiva non prevede in realtà l’obbligo legale di monitoraggio delle comunicazioni, anzi sancisce proprio il contrario.

Dialoghi tra stakeholders

Il paragrafo 10 prevede che a decorrere dalla data di entrata in vigore della direttiva, la Commissione europea organizzerà dialoghi tra le parti interessate “per discutere le migliori prassi per la cooperazione tra i prestatori di servizi di condivisione di contenuti online e i titolari dei diritti”. La Commissione poi emetterà degli orientamenti relativi all’applicazione dell’articolo 17, “in particolare per quanto concerne la cooperazione di cui al paragrafo 4”, cioè i “massimi sforzi per ottenere un'autorizzazione”, gli “elevati standard di diligenza professionale di settore” e “i massimi sforzi” per assicurare la rimozione di contenuti, e l’“aver agito tempestivamente, dopo aver ricevuto una segnalazione sufficientemente motivata” per rimuovere i contenuti, oltre ai “massimi sforzi per impedirne il caricamento in futuro”.

Si prevede anche di sentire le associazioni degli utenti che, ai fini del dialogo, “hanno accesso a informazioni adeguate fornite dai prestatori di servizi di condivisione di contenuti online sul funzionamento delle loro prassi”.

In sostanza, molti dei termini generici utilizzati nella direttiva probabilmente troveranno un contenuto tramite un dialogo tra le parti interessati, cioè principalmente l’industria del copyright e le piattaforme tecnologiche.

Immagine in anteprima via Pixabay.com