Facebook e la lotta alla disinformazione. Dubbi e domande sull’iniziativa

7 min letturadi Angelo Romano e Arianna Ciccone

Una nuova iniziativa per combattere la diffusione delle notizie false e la disinformazione in Italia. Facebook ha annunciato in un comunicato stampa quattro nuove azioni affinché le persone trovino sulla piattaforma informazioni accurate in modo tale da "creare una comunità informata" e aiutare gli iscritti al social network "a prendere decisioni più consapevoli su cosa leggere e condividere". Un'esigenza, spiega Facebook, ancora più forte ora in un periodo di campagna elettorale.

Sono quattro gli interventi previsti: il fact-checking delle notizie condivise su Facebook, la diffusione di uno strumento educativo contro la disinformazione, l'avvio di una collaborazione con AGCOM (l'Autorità per la Garanzia nelle Comunicazioni), l'avvio di un dialogo con i candidati e i partiti politici sulla sicurezza e su come utilizzare la piattaforma.

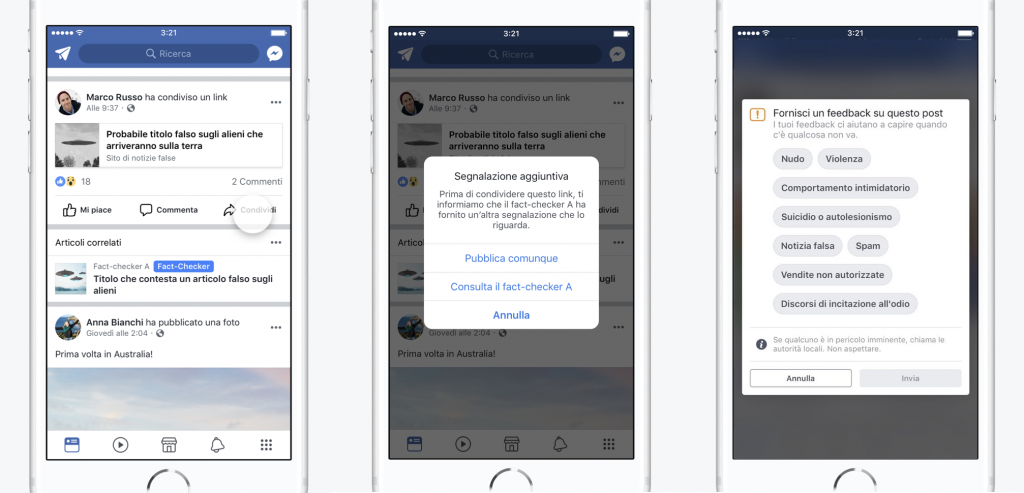

La novità più importante è lo sviluppo del proprio programma di fact-checking che verificherà se le notizie condivise dagli iscritti a Facebook sulla piattaforma siano vere o false. Funziona così: se un post contiene un link a una possibile notizia falsa, chiunque potrà segnalarlo a Facebook, che avvierà un processo di controllo affidato a un soggetto terzo.

Il compito di verificare (e smascherare) le eventuali notizie false diffuse sulla piattaforma è stato affidato a Pagella Politica, sito specializzato nel verificare la veridicità delle dichiarazioni dei politici e che ha stipulato con Facebook un accordo commerciale. Pagella Politica è stato l'unico sito in Italia a sottoscrivere i principi internazionali del fact-checking dell'istituto Poynter, che chiedono neutralità, trasparenza e correttezza nello svolgere l'attività di verifica delle notizie. Come ha spiegato a Repubblica Giovanni Zagni di Pagella Politica, che guiderà un team di 5 persone affiancato da alcuni collaboratori, «ci occuperemo solo di bufale evidenti e sempre relative a link esterni. Dal fact-checking sono esclusi gli status, le foto e i video caricati direttamente su Facebook». Saranno sottoposti a verifica, dunque, esclusivamente gli articoli condivisi sulla piattaforma.

Una volta giudicata falsa, la storia – si legge nel comunicato – non verrà cancellata, né verrà contrassegnata come tale, ma sarà resa meno visibile e spostata nella parte bassa del News Feed (vale a dire l'home page del social network, dove scorrono tutti i post condivisi dalle persone e pagine che seguiamo o con cui siamo in contatto). Sotto al post, per dare più informazioni di contesto, Facebook pubblicherà l'analisi di Pagella Politica e a tutti coloro che staranno per condividere quella stessa notizia arriverà una notifica che li avviserà di essere in procinto di diffondere una notizia falsa.

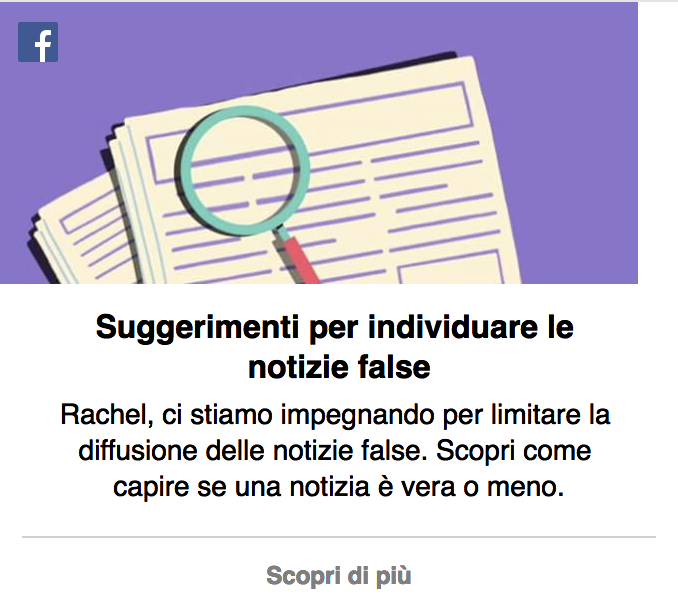

Contemporaneamente, Facebook renderà disponibile, anche durante il periodo elettorale, un elenco di 10 suggerimenti, elaborato insieme alla Fondazione Mondo Digitale, per aiutare le persone a "individuare le notizie false e a prendere decisioni più informate quando le trovano – dentro e fuori Facebook". Questo decalogo sarà disponibile nella parte alta del News Feed, sarà consultabile sulla pagina del Centro assistenza e, dal 5 all’11 febbraio, verrà pubblicato anche su alcuni dei principali quotidiani italiani.

Leggi anche >> I consigli di Facebook sulle fake news: perché sono inutili e dannosi

Sarà, infine, avviato un dialogo con candidati e partiti politici sulla sicurezza e su come utilizzare la piattaforma. Le pagine e i profili dei candidati saranno protetti da tentativi di hackeraggio con il servizio Security Megaphone, "uno strumento che apparirà in cima al loro News Feed per spiegare l'importanza dell'autenticazione a due fattori". Ai politici sarà, inoltre, riservato il sito Facebook Elections, per spiegare loro l'uso più consono della piattaforma attraverso la presentazione di linee guida, suggerimenti e best practices.

Queste iniziative si inseriscono in uno sforzo avviato da tempo dal social network per combattere la disinformazione, attraverso l'introduzione di una serie di misure che hanno cercato di limitare la diffusione di notizie provenienti da fonti che utilizzano titoli acchiappa-click "che distorcono o esagerano le informazioni", di ridurre l'influenza degli spammer, "togliendo priorità ai link che condividono più frequentemente rispetto ad un utente normale", di impedire la possibilità di personalizzare le anteprime dei link (modificandone titolo e immagine), un canale utilizzato per diffondere notizie false.

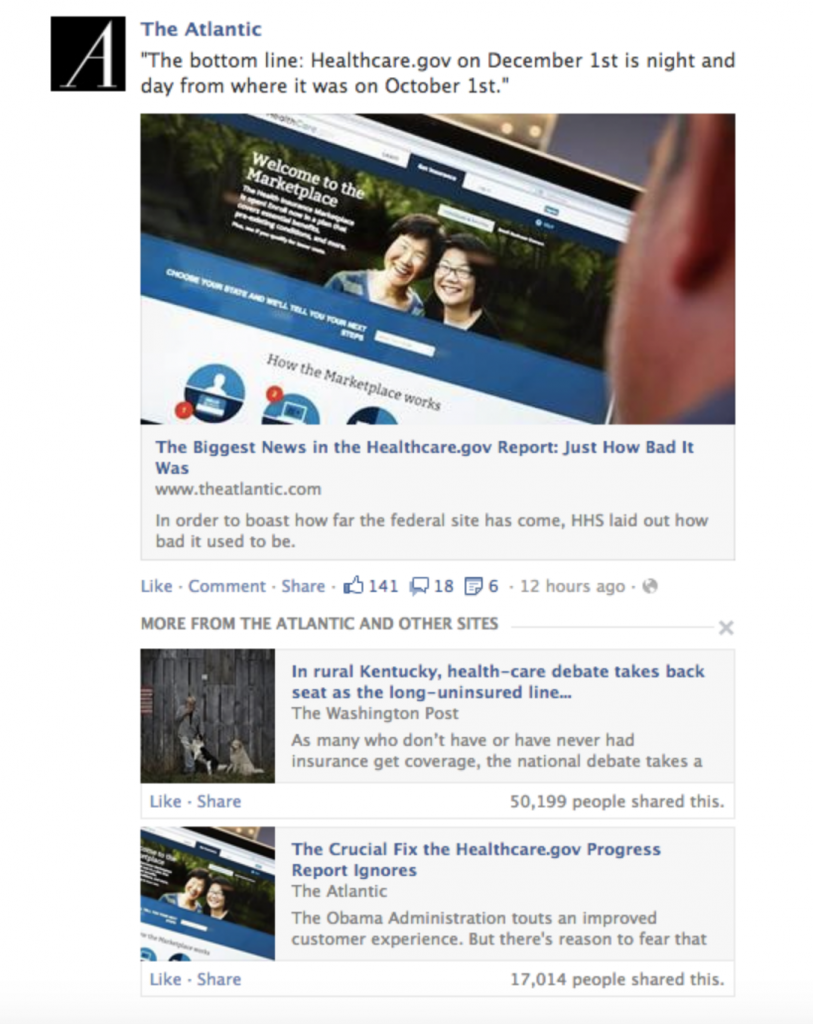

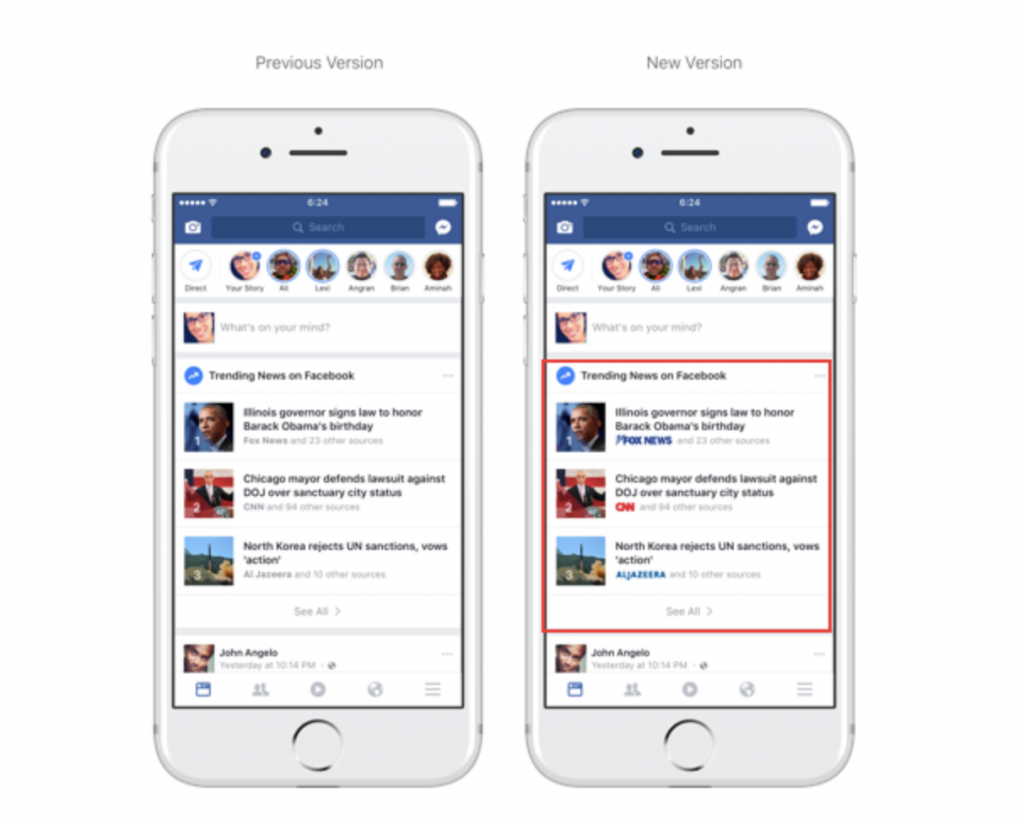

Inoltre, è stata introdotta la visualizzazione di articoli correlati sullo stesso tema nel momento in cui leggiamo un articolo condiviso su Facebook, "per dare alle persone più contesto su una notizia e per aiutarle a capire se ciò che stanno leggendo è fuorviante o falso" e accanto agli articoli, presenti nelle sezioni Trending e Search, sono stati inseriti i loghi degli editori "per aiutare le persone a capire meglio la provenienza dei contenuti che leggono sulla piattaforma".

Tutti questi servizi sono già stati sperimentati negli Stati Uniti, Germania, Francia e Olanda e sulla loro efficacia è stata espressa più di una perplessità dagli stessi fact-checkers coinvolti nell'attività di verifica degli articoli diffusi sul social network. Lo strumento messo a disposizione – spiegava al Guardian Aaron Sharockman, direttore esecutivo di PolitiFact, uno dei soggetti terzi (insieme ad Associated Press, Snopes, ABC News e FactCheck.org) con cui Facebook aveva stretto un accordo per individuare e segnalare le notizie false – si era rivelato poco efficace perché chi diffondeva "fake news" era in grado di riproporre lo stesso contenuto su siti differenti con url diverse (ossia l'indirizzo che noi digitiamo nel browser quando cerchiamo una pagina o un file su un motore di ricerca e che identifica una risorsa su Internet come un documento o un'immagine), aggirando così la segnalazione dei fact-checkers. Inoltre, le notizie contrassegnate come false ricevevano ancora più condivisioni e così lo strumento individuato per ridurre la diffusione di "fake news" si era rivelato controproducente.

Anche il numero delle notizie false individuate si è rivelato esiguo. Come raccontato a Repubblica da Lord Richard Allan, vicepresidente di Facebook per l'area Emea (Europa, Medio Oriente, Africa) e manager della società californiana specializzato nei rapporti con i governi e le istituzioni, nei progetti avviati in Olanda, Francia, Germania e Stati Uniti le notizie false individuate non superano le centinaia: «Più grande è l'elezione e maggiore è l'interesse internazionale, come nel caso delle elezioni americane, maggiore è la possibilità che si diffondano false notizie. Penso che però possiamo parlare di decine o centinaia, non migliaia».

Di certo, si tratta di un cambiamento importante rispetto all'operato di Facebook che, in modo piuttosto esplicito, ha scelto di intervenire in prima linea nello stabilire una gerarchia dei contenuti diffusi sul social network, distinguendo tra ciò che è ritenuto vero o falso. Una decisione che arriva dopo le sollecitazioni da parte di governi, politici e media che in tutto il 2017 hanno visto nelle notizie false una minaccia per la democrazia, ritenute capaci di alterare l'esito delle elezioni, senza però studi in grado di verificarne effettivamente l'impatto. Anzi alcune ricerche hanno mostrato come il loro impatto sia stato irrilevante e il consumo di quella tipologia di informazioni abbia rafforzato solo chi era già polarizzato. Come ammesso dallo stesso Allan, sempre a Repubblica, «per anni abbiamo costruito team di tecnici forti perché gli account fossero protetti, mettendo al primo posto la privacy e la sicurezza dei dati. Ma poi è emersa la disinformazione nel contesto politico. Ora abbiamo un team attento all'abuso della piattaforma per diffondere propaganda anche con account falsi».

Leggi anche >> Davvero le ‘fake news’ sono una minaccia per la democrazia?

A chi sostiene che con questa iniziativa Facebook sia da considerare un editore, Allan risponde che «gli editori producono i contenuti e scelgono quello che va sul giornale. Noi non scegliamo e non scriviamo il contenuto che va su Facebook, la gente scrive e gli individui scelgono cosa leggere e con chi connettersi. Ma abbiamo delle responsabilità». In altre parole, con questa iniziativa, Facebook starebbe semplicemente garantendo la neutralità e affidabilità della propria piattaforma senza considerarsi responsabile dei contenuti condivisi e pubblicati dagli iscritti al social network e, pertanto, un editore.

Sullo sfondo, però, anche alla luce della recente iniziativa del ministro Minniti di affidare alla polizia il compito di verificare sospette notizie false segnalate dai cittadini, restano diverse perplessità, a partire dalla spasmodica attenzione sulla presunta "emergenza fake news" e dalla pressione da parte di media e politici sui social network, considerati il luogo quasi elettivo della diffusione delle notizie false, come testimoniato anche da diverse iniziative di carattere istituzionale:

1) Esistono dati, ricerche sull'Italia per comprendere tipologia, reale volume e impatto di queste "fake news"? Si parla di emergenza e Minniti, ieri, Facebook, oggi, hanno lanciato iniziative per contrastarle. Ma cosa conosciamo di questo "fenomeno"? Cosa intende Minniti quando usa l'espressione "fake news"? Di che cosa stiamo parlando esattamente? Di migliaia e migliaia di false informazioni prodotte ogni giorno? Da chi? Cosa sappiamo su numeri e qualità delle condivisioni? Abbiamo studiato l'emergenza prima di decidere che fosse una emergenza e poi individuare la cura? O stiamo curando la malattia senza una diagnosi?

2) Come mai in tutte queste iniziative non si parla mai e non si tiene conto delle false notizie prodotte e veicolate dal mainstream?

3) Come mai tra i pericoli della disinformazione (nel lanciare l'iniziativa Facebook parla di lotta alla disinformazione) non si tiene conto della propaganda politica, o anche brutalmente delle "palle" che sono dette soprattutto in campagna elettorale dai politici, che in nome del consenso non si fanno scrupolo di ingannare i cittadini (come quanto accaduto con i politici sostenitori del Leave durante la campagna per il referendum su Brexit)? Solitamente poi balle incontrastate da parte dell'intervistatore soprattutto durante - inutili e dannose - interviste televisive.

4) Facebook annuncia una iniziativa di fact checking sui contenuti diffusi sul social in collaborazione con Pagella Politica. Di fatto fa quello che ha sempre negato di voler fare: intervenire sui contenuti, per stabilire ciò che è vero e ciò che è falso. Considerate le pressioni ricevute dalla politica, questa forse è la soluzione migliore possibile. Ma ha comunque aspetti controversi: cosa succede se il fact-checking è sbagliato, c'è la possibilità di appellarsi? Chi è responsabile di eventuali errori? Come saranno individuati i contenuti da verificare? Saranno sottoposti a fact-checking anche articoli dei media mainstream e i "post-dichiarazioni" dei politici? Se no, perché? In altre parole, Facebook si trova ad affrontare, suo malgrado, questioni editoriali.

Resta, però, un aspetto positivo: con questo metodo potremmo finalmente capire di che emergenza stiamo parlando, a patto però che Facebook - e lo chiediamo pubblicamente - faccia un report in trasparenza di cosa è stato verificato e perché.

Immagine in anteprima via Facebook